並び順

- おすすめ順

- 新着順

- No elements found. Consider changing the search query.

- List is empty.

案件一覧

( 5,664 件中 271 - 280 件を表示) 【作業内容】 ・生成AIを用いて調査活用させた ビジネスインテリジェンス提供プラットフォームPoC 【スキル】 ■AIチャット対応エンジニア:2名 ・インフラ(Azure)とアプリ(React) 半々の対応になる想定 ・AIに強くリーダーのご対応が可能な方:1名 ・AIに強い方:1名 ■分析:1名 ・Azure上で分析やダッシュボード作成などを行う Azure上での分析やダッシュボードの経験がある方 【契約内容】 期間:2026年4月1日~9月末を予定 (以降は延長ないし別案件へのスライドの可能性があります) 現場:フルリモート想定(PC受け取りの為初日出社有り) 【募集人数】:3名(AIチャット2名、分析1名) 【面談】:2回(ともにWEB)

スキル

【案件概要】 通信企業向けの既存システムの廃止に伴い、Snowflakeを活用したDWH上でのデータ加工処理・アプリケーション開発を行う案件です。 ・Salesforce等の複数データソースからSnowflakeへ取り込まれたデータを加工・集約する処理の実装 ・Snowflake上のデータを用いて、既存システムで提供していたデータサービス/帳票機能の再構築(リファクタリング) ※基盤は別チームが担当 ・Snowflake上でのデータ加工・集計処理(SQL中心)の設計・実装 ・Python/Shell等を用いたバッチ処理の開発 ・既存設計書・データ仕様書の読解、データ構造の整理 ・実装方針・仕様について顧客と調整 【必須スキル】 ・SQLによるデータ加工・集計の実務経験(3年以上目安) ・DWHを用いたデータ加工/ETL開発経験 ・PythonまたはShellによるバッチ開発経験 ・設計書を読み解き実装へ落とし込んだ経験 【尚可スキル】 ・Snowflakeでの開発経験 ・AWS等クラウド環境での開発経験 ・GitHub等によるソース管理経験 ・dbtでの開発経験 【作業環境】 Windows/Mac選択可 【就業時間】確認中 【契約更新】初月単月(以降複数月更新) 【商流】元請→上位→上位→当社 【精算幅】140〜180 【面談回数】2 【服装】オフィスカジュアル 【最寄駅】都内 【管理番号】anken_16067_1343

■案件の内容 国内トップクラスの生成AIスタートアップにて、大手企業向けの受託開発エンジニアを担当いただきます。 AIコンサルタントが定義した要件に基づき、LLM連携、RAG構築、AIチャットボット、業務自動化ツールなどの設計・実装から納品までを一気通貫で担うポジションです。 大規模のプロジェクトが並行しており、OpenAIやAnthropicなどの最新API、AIエージェント、既存システムへのLLM統合など、生成AI技術の最前線に日常的に触れることができます。 開発プロセスにはClaude CodeやCursor等の最新ツールをフル活用しており、圧倒的な開発スピードと品質を両立させる開発スタイルが特徴です。 IPOを見据えた急成長フェーズにあるため、確かな実装力を持ち、技術をビジネス価値に転換できる意欲的な方を募集しています。 ■求めるスキル: ・Python または TypeScript を用いたWebアプリケーション開発の実務経験 ・APIの設計および実装経験 ・OpenAI / Anthropic などのLLM APIを用いた開発経験、または強い学習意欲 ・Gitを用いたチーム開発経験 ■歓迎スキル: ・RAG(検索拡張生成)、ベクトルDB、Embeddingの実装経験 ・React / Next.js を用いたフロントエンド開発経験 ・FastAPI / Django / Flask 等を用いたバックエンド開発経験 ・AWS / GCP / Azure 上でのインフラ構築・運用経験 ・受託開発またはSI企業でのプロジェクト経験 ■開発環境(主な構成): 言語:Python, TypeScript フロントエンド:React, Next.js バックエンド:FastAPI, Django, Flask 等 LLM/AI:OpenAI API, Anthropic Claude API, Vector DB インフラ:AWS, GCP, Azure ツール:Git, Claude Code, Cursor

【フルリモート/週5/Azure】データ分析基盤構築エンジニア(Azure/Synapse/Data Factory) お任せしたいこと [役割] Azureエンジニアとして、全社データ活用を推進する分析基盤の構築を担当。データ収集からETL設計、DWH構築、可視化基盤連携までを一貫して推進していただきます。 [役割に対して求める成果] 安定稼働するAzureデータ基盤の構築 データ収集・加工の自動化 経営判断に活用できる分析環境の整備 具体的な業務内容 Azure Data FactoryによるETL設計 Azure Synapse Analytics設計・構築 Blob Storage設計 データパイプライン最適化 Power BI連携設計 監視および運用設計 必須スキル・経験 Azure設計・構築経験3年以上 Data Factory利用経験 SQLによるデータ加工経験 DWH設計経験 ドキュメント作成経験 歓迎スキル・経験 Synapse利用経験 データモデリング経験 大規模データ処理経験 BIツール導入経験 開発環境 クラウド:Azure ETL:Azure Data Factory DWH:Azure Synapse Analytics ストレージ:Azure Blob Storage 可視化:Power BI 管理:Teams, Azure DevOps 開発チームについて データエンジニア3名/BI担当2名/PM1名 全社データ活用推進チーム 段階的拡張プロジェクト 求める人物像 データ活用に興味がある方 構造化して考えられる方 主体的に改善提案できる方 仕事の魅力 Azureデータ基盤構築の中心メンバーとして参画可能 データエンジニアとして専門性を高められる フルリモートで安定して参画可能 働き方 リモート環境 [フルリモート] フルリモートで働いていただけます。

【案件名】 エンド企業内の内製開発エンジニア(Ruby/AWS) 【業務概要】 自動車販売システムを展開するエンド企業にて、 DevOpsチームの一員として、各種システムの開発・保守をご担当いただきます。 本チームでは要件が固まる前のトライ&エラーや、R&D的な課題解決も担当しており、 開発・インフラ問わず幅広い領域をカバーしながら開発を進めています。 裁量も非常に大きく、高いレベルで様々な経験を積むことができます。 【条件】 ・単価:80~100万程度(スキル見合い) ・時期:4月~ 長期 ・リモート頻度:週4日リモート ・場所:品川駅 ・募集人数:1名 ・外国籍:不可 ・個人事業主:可 ・精算:140-180h ・面談:Web1回(弊社同席) 【必須スキル】 ・Ruby on Railsでの開発経験 3年以上 ・AWS上での開発経験(AWSリソースをご自身で操作した経験) ・障害対応、監視などの保守運用経験 【尚可スキル】 ・AWS, Azure, GCP等のインフラ設計もしくは構築経験 ・アーキテクチャ設計の経験 ・スクラム開発の経験 ・MVCモデルを用いた開発経験 ・SQLを用いた開発~運用保守の経験 ・RDBやNoSQLなどのDBに関する知見 ・メンバーへの教育経験 【人物像】 ・チームが成果を出すために必要な思考や行動をとれる方(重要) ・積極的なコミュニケーションが取れる方 ・新しい技術や未経験技術に対して、好奇心旺盛な方 【環境】 言語等:Ruby on Rails, MySQL クラウド:AWS, 一部GCP 【備考】 ・商流:エンド直 ・支払いサイト:35日 ・契約形態:準委任契約(履行割合型) ・稼働率:週5のみ ・就業時間:9:30-18:30 ・服装:私服(オフィスカジュアル) ・PC貸与:あり(基本はMac)

スキル

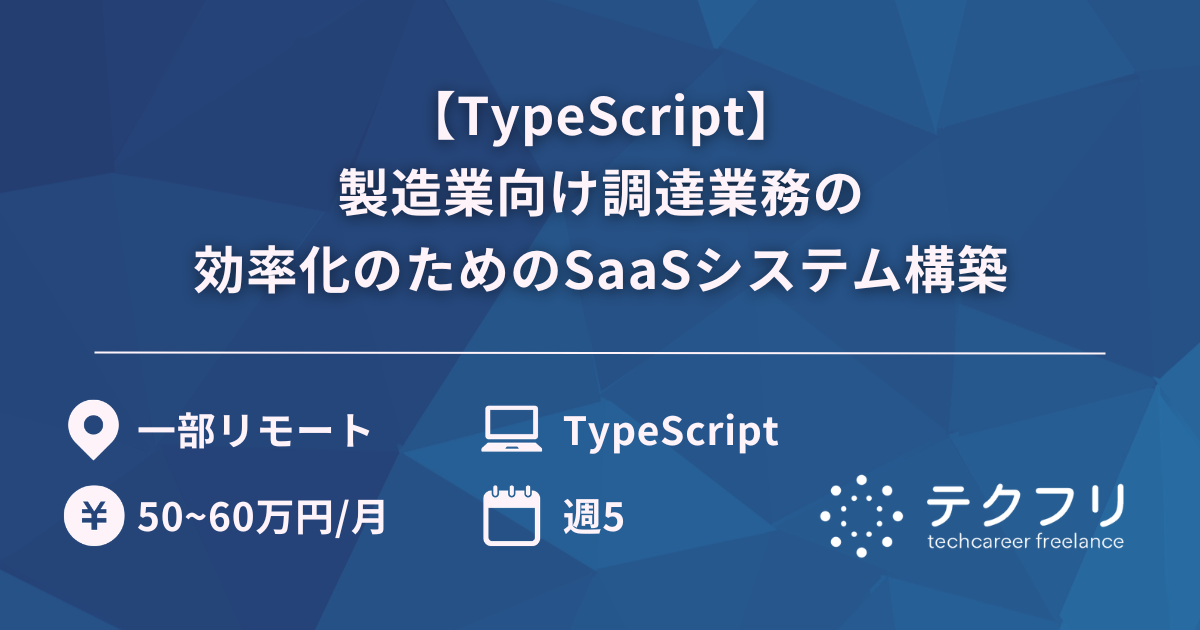

【案件概要】 製造業における調達業務の効率化のためのSaaSシステムの構築をお願いします。 基本設計からレビューまでをお任せいたします。 下記主な作業内容となります。 ・基本設計・詳細設計 ・開発・テスト ・ソースレビュー 【必須スキル】 ・業務系システム構築案件でのNest.js、Pythonを用いた設計・構築経験(3年程度) ・TypeScriptの経験(目安: 3年~5年以上) ※Javaの経験5年以上+JavaScriptの経験3年以上ある方はTypeScriptの経験がなくても検討可 ・クラウド(AWS)サービスとの繋ぎ込み経験(例: S3、Lambda、AWS Batch) ・一人称で設計・開発をした経験 【尚可スキル】 ・以下の言語およびAI・データ基盤分析基盤の経験 NumPy、Pandas、Claude Code、 OpenAI、 LangChain、FLAML・マクロサービスもしくはドメイン駆動設計のプロジェクト経験 ・AWSの基礎知識 ・AI駆動(Claude code)開発の経験 【作業環境】 Windows/Mac選択可 【就業時間】9:00〜18:00 【契約更新】初月単月(以降複数月更新) 【商流】元請→上位→当社 【精算幅】140〜180 【面談回数】2 【服装】オフィスカジュアル 【最寄駅】外苑前駅 or 六本木駅 【管理番号】anken_16067_1339

【案件名】 Datadog自動化開発支援 【業務概要】 DatadogのWorkflow Automationを使用してサーバーの正常性の確認やサーバーの再起動、障害復旧を実現したい。 監視オペレーターの一次対応を自動化するイメージ。 必要スキル:AWSやAzureの知見、運用設計経験、運用自動化の要件が理解できる、自己タスクの管理、顧客折衝 任意スキル:Datadogで独力で実現できること、JavaScript(Datadog AIがコーディングをサポート) ・新規UI設計・開発 ・コード品質や保守性向上のための改善提案と実装 ・ビジネスサイドやデザイナーとの要件定義、仕様調整 【条件】 ・単価:~90万(スキル見合い) ・時期:即or4月~ ・場所:半蔵門(基本常駐) ・募集:1名 ・精算:140-180h ・面談:1回(サクヤ同席) 【必須スキル】 ・AWSもしくはAzureの知見 ・運用設計経験 ・運用自動化の要件が理解できる ・顧客折衝経験 【尚可スキル】 ・Datadogで独力で実現できること 【備考】 ・支払いサイト:35日 ・契約形態:準委任契約 ・外国籍不可

スキル

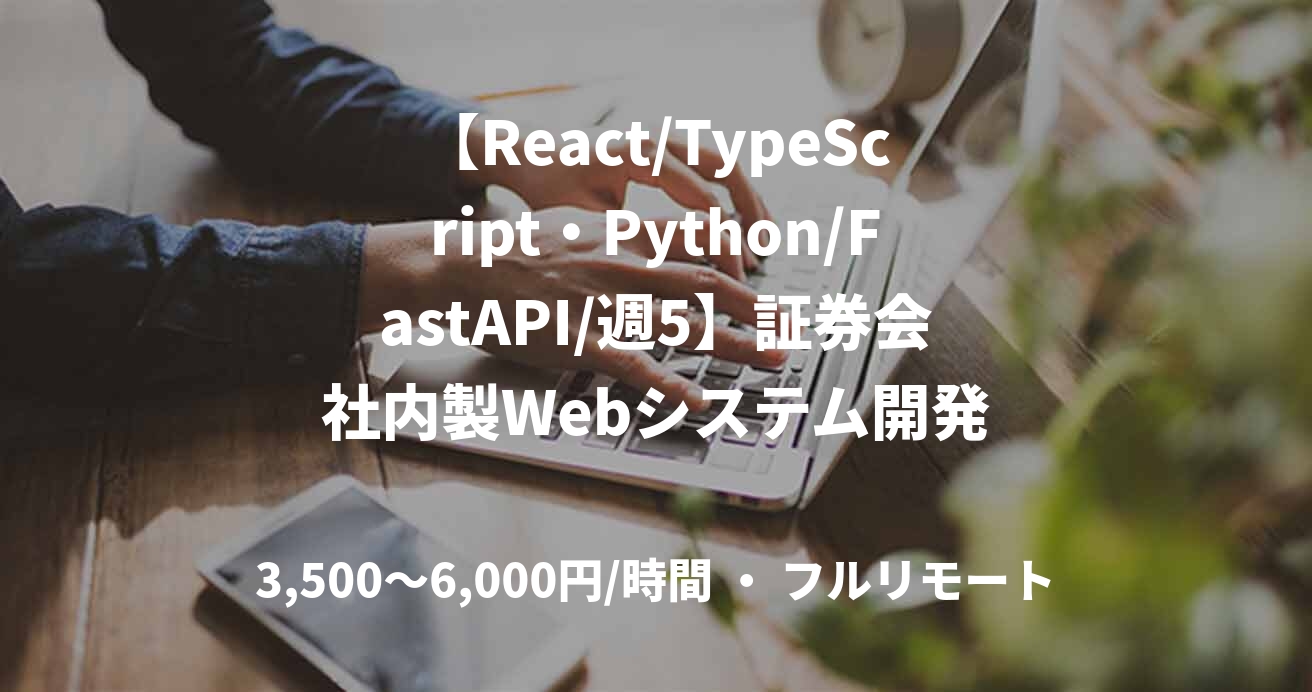

〓〓〓〓〓〓〓〓〓〓〓〓〓〓〓〓〓〓〓〓 1.作業期間 :2026年4月~2026年6月(延長有) 2.作業内容 :証券会社社内用 システムの内製開発 ・社内用 Web システムのフロント、バックエンドを開発 ・開発手法はアジャイル (朝会 11:00-11:30 基本 社員含む全員) ・ユーザーは社内部署、ユーザーヒアリングは社員が実施 ・開発は社員とベンダーで実施 設計、開発、テスト、UAT、リリース 3.作業場所 : 在宅勤務(自宅、もしくは自社でのリモート作業) 4.開発環境 : OS 等:Windows, Windows (Server) ツール等:Azure Dev Ops (Repos, Boards, Pipeline), VSCode, A5M2 Docker リリースイメージ作成含む 5.開発言語等 :Python, SQL ーーーー 人 数 :1名 金 額 :スキルにより要相談 条 件 : ●技術要件 【必須】Front:React, TypeScript 【必須】Back:Python, SQL , FastAPI, OpenAI, nginx ●人物要件 【必須】報連相が出来る方 【必須】勤怠がしっかりしている方 【必須】誰とでも明るくコミュニケーションできる方 【必須】チームに貢献する意識がある方 【必須】タスクを待つのではなく自ら取りに行ける方 ●Web面談1回(弊社同席) 〓〓〓〓〓〓〓〓〓〓〓〓〓〓〓〓〓〓〓〓

スキル

【案件名】 動画配信事業者向け ネットワークサーバ複合構築 【業務概要】 某動画配信事業者向けのネットワーク/サーバ複合構築案件において、 サーバ領域を中心としてご支援いただきます。 本案件では、 Azure(Azure Virtual Desktop含む)環境を前提としたインフラ基盤の設計・構築を推進します。 Windows/RHELサーバの設計、Active Directory/DNSを含む認証基盤整備、 Zabbixによる監視設計、ストレージ(NetApp)設計など、サーバ領域全般をご担当いただきます。 また、ネットワーク設計(L2/L3/FW)との整合を取りながら、 非機能要件(可用性・性能・セキュリティ・運用性)の整理、 設計書作成、試験計画策定、ベンダー調整まで対応いただきます。 【条件】 ・単価:75~90万 ・期間:即日または4月 ~ 長期 ・リモート頻度:週1~2日リモート ・場所:大崎 ・募集人数:1名 ・外国籍:不可 【必須スキル】 ・インフラ案件における要件定義経験 ・Windows/Linux両方の設計経験3年以上 ・ネットワークの知見がある方 ・長期参画可能な方 【尚可スキル】 ・直近3年以内のクラウド(Azure/AWS/GCP)設計・構築経験 ・仮想化環境(VMware/Proxmox)経験 ・AD/DNS/NetApp/バックアップサーバ構築経験 ・Zabbixなど監視システム設計経験 ・Azure AVD 経験 ・NW機器(L2/3、FW、WLC/AP)理解 ・仕様未確定段階からの仮説立案、合意形成経験 【技術要素】 ・クラウド:Azure(AVD含む) ・OS:Windows Server/RHEL ・仮想化:VMware/Proxmox ・監視:Zabbix ・NW:L2/L3/FW ・ストレージ:NetApp 【備考】 ・精算幅:140-180h ・勤務時間:9:30~18:00(7.5h) ・交通費:主勤務地分は契約金額に含む ※現場作業や打合せ同行時の交通費は別途精算 ・繁忙期は残業30h程度、夜間/休日対応の可能性あり

スキル

■ 案件名:ライフデザイン領域のデータ分析支援 ■作業内容 お客様とコミュニケーションを取りながらデータ分析を行う Pysparkを使ったデータ抽出・Excel集計 デジタルマーケティング等の施策、効果検証 扱うデータは顧客情報、購買ログ、アクセスログといったもの、データ量は顧客情報で2000万件 データ量に関して、アクセスログなどを扱う場合は数億〜数十億件になることも ■必須スキル 上記の作業内容になる為記載のスキル感を持った方を募集させて頂いております Python実務経験3年以上目安 データマート構築に関する経験/知見 分析レポートの作成及びレポーティングの実務経験 分析要件定義経験 コミュニケーション能力 ■尚可スキル 大規模データマートのハンドリング経験 デジタルマーケティングの知見 AWS,snowflakeなどのクラウド環境の経験 ■条件面 時期:2026年4月から長期 定時: 9:00~18:00(休憩1時間) 場所:高輪ゲートウェイ 単価:スキル見合い 出勤:基本出社(セキュリティレベルの高いデータを扱うため。ドキュメント作成などセキュリティレベルの低い作業あれば、リモートも可) 人数:2名 備考: ※期間転籍必須 ※本案件は大手通信キャリアグループ企業の契約社員になって頂く必要がございます

スキル